IA et vishing : quand votre voix devient une menace

Les cybermenaces ne cessent d’évoluer, s’adaptant aux nouvelles technologies pour cibler leurs victimes avec une efficacité redoutable. Parmi ces menaces, le vishing, ou phishing vocal, se démarque par sa capacité à manipuler les individus par la voix.

Si cette technique existe depuis de nombreuses années, l’utilisation de l’intelligence artificielle (IA) dans ces attaques change profondément la donne, rendant les fraudes plus convaincantes et plus difficiles à détecter.

L’émergence de l’IA permet aux cybercriminels d’automatiser les appels, d’exploiter des données personnelles pour créer des scénarios sur mesure mais aussi d’usurper des voix de façon très réaliste.

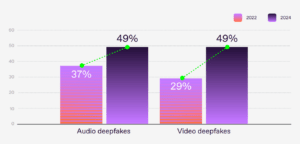

Selon une étude publiée par Regula, 49 % des entreprises mondiales ont été confrontées à des usurpations d’identité par deepfake audio en 2024, contre seulement 37 % en 2022.

Le pourcentage d’entreprises ayant détecté des deepfakes audio et vidéo en 2022 et 2024. Source : Regula

Les avancées technologiques et les liens grandissants entre IA et vishing ne font qu’amplifier l’impact des attaques par phishing vocal, qui visent aussi bien les particuliers que les entreprises, les administrations ou bien encore les associations.

IA et vishing, deepfake et deepvoice : tour d’horizon et définitions

Deepfake : l’IA au service de la fraude

Un deepfake, contraction de « Deep Learning » et « Fake », est une technologie qui utilise l’intelligence artificielle pour créer ou modifier des contenus visuels, audio ou vidéo, en imitant de manière réaliste des visages, des voix ou des gestes.

Elle permet de superposer un visage ou une voix sur un autre support pour simuler des situations qui n’ont jamais eu lieu.

Les deepfakes audio sont parfois appelés deepvoices. Cette technologie se concentre spécifiquement sur la synthèse et l’imitation de la voix humaine. Grâce à des modèles d’apprentissage profond, les systèmes deepvoice peuvent analyser des échantillons de voix pour la cloner de façon extrêmement convaincante.

Ces techniques apportent des opportunités notamment dans le milieu musical ou médical. Mais elles soulèvent aussi des préoccupations éthiques et sécuritaires, notamment en matière de cybersécurité et plus particulièrement d’hameçonnage vocal (vishing).

En quoi consiste le vishing ?

Le vishing (aussi appelé « voice phishing » ou phishing vocal) est une forme de fraude téléphonique où des cybercriminels se font passer pour des interlocuteurs de confiance afin d’obtenir des informations sensibles.

Contrairement à un hameçonnage par email (phishing), le vishing repose sur des appels vocaux. Mais dans les deux cas il s’agit d’utiliser des méthodes d’ingénierie sociale afin de tromper les victimes en exploitant leurs émotions (peur, confiance, sentiment d’urgence, etc.).

Les attaquants se font en général passer pour des représentants d’entreprises connues, de banques, ou encore d’administrations pour abaisser la vigilance de leur cible.

L’objectif des vishers (cybercriminels pratiquant le vishing) est de pousser la victime à divulguer des données confidentielles. Il peut s’agir d’identifiants, de mots de passe, d’informations bancaires ou d’accès à des systèmes internes.

Cette forme de cybercriminalité est particulièrement redoutable car elle présente un taux de réussite alarmant. C’est d’autant plus le cas quand IA et vishing sont couplés grâce à l’utilisation du deepvoice.

Comment fonctionne le deepvoice ?

Depuis quelques années, on assiste au développement de logiciels utilisant des technologies de synthèse vocale. Ils permettent de générer des voix réalistes grâce à l’intelligence artificielle.

Ces plateformes proposent des outils pour créer des voix personnalisées, imiter des voix existantes ou générer des narrations dynamiques dans plusieurs langues. Elles sont notamment utilisées dans la production de contenu, l’éducation, le divertissement, les solutions d’accessibilité, etc.

Même si ces entreprises interdisent théoriquement l’utilisation frauduleuse de leurs outils, il existe dans la réalité peu de garde-fous.

D’après des recherches effectuées par McAfee, il suffit de 3 ou 4 secondes d’enregistrement d’une voix pour réussir à la cloner en utilisant des outils disponibles sur Internet.

Même avec des outils gratuits, les chercheurs ont pu reproduire une voix fidèle à 85 % à l’original. Avec des outils plus perfectionnés et plus de matière première, le taux de fidélité monte à 95 %.

L’accès aux deepvoices est donc devenu très simple et ne nécessite plus de compétences techniques particulières. Selon Recorded Future, des cybercriminels proposent même leurs propres services de clonage de voix moyennant finance.

IA et vishing : Sésame, ouvre-toi

Le deepvoice pour faciliter l’accès initial

Pour compromettre un système par une attaque de vishing, un cybercriminel a besoin d’un accès initial. Cela passe en général par un appel direct du pirate à sa victime. Parfois la cible reçoit un mail lui demandant de rappeler elle-même le criminel, en prétextant par exemple la résolution d’un problème technique.

Dans tous les cas, le visher joue un rôle et usurpe l’identité d’une personne qui va inspirer confiance à la victime (conseiller bancaire, technicien informatique, membre de l’administration, etc.)

Avec l’utilisation d’un deepvoice, l’accès initial est facilité. Le fait de pouvoir usurper, non plus seulement un rôle, mais une voix associée à ce rôle, facilite grandement la mise en confiance de la victime.

D’autant plus lorsque l’attaque utilise en parallèle le spoofing, une technique relativement simple à mettre en œuvre qui permet au hacker d’usurper un numéro de téléphone.

En se faisant passer pour un supérieur, un collègue ou bien encore un conseiller bancaire personnel, le visher n’a pas à convaincre son interlocuteur de qui il est. Il reconnaît directement une voix familière.

Cela incite plus facilement la cible à effectuer une opération financière, à accorder un accès à distance au système informatique ou à transmettre des données sensibles.

Mouvement latéral et escalade de privilèges

Dans le cadre du vishing, un assaillant peut être amené à utiliser deux techniques pour parvenir à ses fins : le mouvement latéral et l’escalade de privilèges.

Le mouvement latéral consiste pour un attaquant à se déplacer à l’intérieur d’un système compromis vers d’autres ressources internes. Cela lui permet d’élargir son accès et de cibler des données ou des systèmes critiques.

L’escalade de privilèges permet quant à elle d’obtenir des droits supérieurs. Le visher peut alors atteindre des données sensibles ou modifier des paramètres auxquels il n’avait pas accès dès le départ.

Or une attaque mêlant IA et vishing permet de faciliter l’intrusion en profondeur des systèmes informatiques.

Concrètement, il est en général plus simple de tromper la vigilance d’un collaborateur dédié au standard téléphonique que celle d’un administrateur de réseau informatique. Ce dernier est en effet plus sensibilisé aux techniques des cybercriminels.

Ainsi, un visher peut très bien enregistrer directement la voix d’un interlocuteur ou récupérer des enregistrements qu’il trouve sur le réseau à la suite d’un accès initial.

Il pourra ensuite entraîner un modèle deepvoice, lui permettant d’engager des interactions crédibles avec d’autres cibles au sein de l’organisation. Il obtiendra alors accès à des systèmes et des données de plus en plus sensibles.

Où les vishers trouvent-ils leurs sources d’information ?

L’évolution des techniques de communication facilite le travail des vishers en leur permettant de récupérer des échantillons vocaux sans même avoir à infiltrer préalablement un réseau.

En effet, de plus en plus de personnes enregistrent leur voix sur Internet. Cela peut se faire via des vidéos postées sur les réseaux sociaux ou via des messages vocaux échangés sur des messageries.

Selon l’étude de McAfee préalablement citée, 55 % des Français enregistrent au moins une fois par semaine leur voix. Une partie de ces enregistrements sont publics et l’autre partie peut très bien le devenir à la suite d’une fuite de données.

En ce qui concerne les dirigeants d’entreprises, les conférences filmées ou les interviews peuvent servir de source à des individus malveillants. L’enregistrement de leur voix sur leur messagerie vocale pour inviter à laisser un message peut tout bêtement être une autre source.

Avec le développement de l’IA, cette ressource peut permettre aux hackers d’usurper très facilement la voix d’une personne pour conduire une attaque directement au plus haut niveau.

Le cocktail IA et vishing : une menace présente et à venir

Quand la réalité rattrape la science-fiction

Toujours d’après l’étude de McAfee, 11 % des Français ont déjà été confrontés directement à une tentative de vishing par usurpation de voix, et 16 % connaissent quelqu’un à qui cela est arrivé.

Pourtant, à l’échelle mondiale, 36 % des adultes interrogés disent ne jamais avoir entendu parler de ce risque. La menace est donc à la fois très sérieuse et sous-estimée.

Par ailleurs, selon l’étude de Regula citée en introduction, plus de 85 % des entreprises considèrent les usurpations d’identité par deepfake audio ou vidéo comme une menace à prendre en considération.

Le rapport indique également que les entreprises sont plus inquiètes des effets négatifs sur leur réputation que des pertes financières liées aux attaques. Ceci explique probablement la discrétion des entreprises touchées et le fait que ce sujet ne soit pas plus médiatisé pour le moment.

Plusieurs cas d’entreprises victimes

Les cas de particuliers victimes d’arnaques utilisant IA et vishing sont nombreux, notamment aux États-Unis. La Federal Trade Commission pointe même le vishing comme l’attaque la plus dangereuse en termes de pertes financières moyennes.

En ce qui concerne les entreprises, les exemples sont plus difficiles à trouver du fait notamment de leur manque de communication en cas d’attaque. Pour autant, quelques cas ont été rendus publics ces dernières années.

En 2019, le dirigeant d’une entreprise énergétique britannique a été victime d’un vishing en virant 220 000 € sur un compte frauduleux après avoir reçu un prétendu appel téléphonique de son PDG situé en Allemagne. L’attaquant a utilisé un deepvoice pour imiter à la perfection la voix et l’accent germanique de la personne usurpée.

Pire encore, début 2024, un employé d’une multinationale a été piégé par une fausse visioconférence au cours de laquelle tous les participants étaient animés par des deepfakes. Bilan : 25 millions de dollars ont été virés en toute bonne foi par le salarié dupé.

Un cas similaire avait déjà été signalé en 2020 avec à la clé 35 millions de dollars dérobés à une entreprise japonaise.

Ces quelques exemples montrent bien le potentiel des attaques combinant IA et vishing. Qui plus est, il faut garder en tête que le pire est probablement à venir et qu’aucune entreprise ne peut se considérer à l’abris.

Des attaques déjà dangereuses malgré des limites techniques

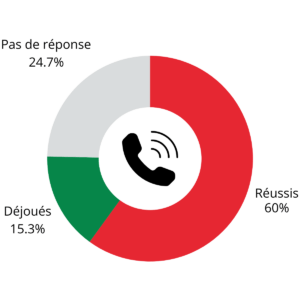

Une étude menée en 2024 par l’École polytechnique de Quito a simulé une campagne de vishing reposant sur des logiciels de clonage vocal grand public.

Les résultats sont effrayants puisqu’en moyenne 60 % des personnes appelées ont transmis des informations sensibles à leur correspondant. Seulement 15 % des cibles ont déjoué l’attaque.

Résultats des tests de vishing menées par l’École polytechnique nationale de Quito sur 150 appels dans un environnement universitaire.

Les différentes études citées soulignent néanmoins les limites des technologies de deepvoice. Les modèles d’IA rencontrent par exemple des difficultés à prononcer correctement les mots compliqués ou à imiter les voix ou des locutions qui sortent de l’ordinaire.

Pour autant il est probable que ces limites seront bientôt franchies et que des évolutions permettront des attaques encore plus poussées.

Deepvoice en direct : un futur fléau ?

L’utilisation du clonage vocal en temps réel est une évolution préoccupante à envisager. Elle permettra aux pirates d’interagir directement avec leur cible.

Actuellement, les vishers créent des enregistrements préalablement à leurs attaques. Puis ils les diffusent une fois en ligne avec leur victime. Si cette dernière sort du script imaginé, l’attaque a de grandes chances d’échouer.

Pour contrer cette limite, les hackers travaillent le scenario pour anticiper les questions que pourraient se poser leurs cibles. Ils évitent ainsi au maximum les interactions comme l’explique un spécialiste dans une conférence disponible en ligne.

Néanmoins, un journal français a récemment rapporté le témoignage inquiétant d’une attaque où le visher a utilisé un deepvoice en direct. Un fils pensant avoir sa mère au téléphone a pu éviter le piège en percevant des incohérences dans les réponses de sa prétendue mère. Il s’agissait du premier cas déclaré en France d’après Cybermalveillance.gouv.fr.

Nous savons donc que ce n’est qu’une question de temps avant que l’IA permette d’utiliser des appels et même des vidéos en « live » de façon suffisamment convaincante.

Comment se protéger contre les attaques combinant IA et vishing ?

Les bons réflexes et les procédures à mettre en place

Lutter contre les vishers n’est pas une mince affaire car la technologie évolue en permanence et les pirates gardent toujours une longueur d’avance. Il existe tout de même quelques procédures et solutions techniques pour se prémunir des attaques combinant IA et vishing.

1. Mettre en place l’authentification multi-facteurs (MFA) pour accéder aux informations critiques ou réaliser des transactions bancaires.

2. Mettre en place des procédures de vérification pour confirmer l’identité d’une personne avant de répondre à des demandes sensibles par téléphone (appel retour sur un numéro vérifié, mot de passe vocal, reconnaissance d’empreintes vocales, etc.).

3. Utiliser exclusivement des chats d’entreprise sécurisés pour toute conversation sensible et n’accorder aucune dérogation à cette procédure.

4. Utiliser des technologies d’authentification et de blocage des appels pour filtrer les appels entrants.

5. Poser des questions spécifiques à l’interlocuteur auxquelles seul quelqu’un qui vous connaît réellement est en mesure de répondre.

6. Être à l’écoute des incohérences dans le discours de l’interlocuteur (pauses inhabituelles, changements de bruits de fond, changements de tons, etc.).

7. Eviter de communiquer des informations si l’interlocuteur suscite le moindre doute.

8. Signaler les appels suspects au service de sécurité informatique et à ses collègues pour éviter que quelqu’un d’autre ne tombe dans le piège.

Ces mesures de protection permettent de réduire le risque de tomber dans le piège du vishing. Toutefois, la liste présentée n’est pas exhaustive et les technologies de défense évoluent sans cesse, tout comme les technologies d’attaque. Contre cette fuite en avant, la meilleure solution reste donc de sensibiliser et de tester les utilisateurs.

Sensibiliser et tester avec une simulation de vishing

La meilleure arme des vishers est l’ignorance de leurs victimes. Une personne sensibilisée a bien plus de chance de déjouer un piège.

La sensibilisation et la communication auprès des proches et des collègues permet de renforcer leur vigilance face aux tentatives de manipulation.

Cette approche permet d’instaurer une culture de la cybersécurité au sein des organisations, où chaque personne devient un maillon actif dans la protection des systèmes et des données sensibles.

Il n’en reste pas moins que pour évaluer le niveau de risque d’une organisation face au vishing, le mieux est d’opter pour une mise en situation (simulation de vishing) pour tester, en conditions réelles, les réflexes des collaborateurs. Cela permet ensuite d’ajuster les procédures en tenant compte des recommandations issues de la simulation.

Vérifiez si votre organisation est prête à contrer une attaque de vishing avec AvantdeCliquer.

Conclusion

L’intelligence artificielle transforme le paysage des cybermenaces, et le vishing en est un exemple frappant. Pour les particuliers, les entreprises, les associations, les organismes publics, « vigilance » et « prévention » doivent devenir les maîtres-mots.

Investir dans la sensibilisation et les simulations de vishing, adopter des solutions technologiques adaptées et renforcer les procédures internes sont autant de leviers pour se protéger.

La lutte contre les menaces croissantes mêlant IA et vishing exige une mobilisation collective et une adaptation constante aux nouvelles réalités technologiques.

Ces risques, bien que parfois encore embryonnaires dans leur déploiement, nécessitent une vigilance accrue et des mesures proactives pour anticiper et contrer leur évolution potentielle.

FAQ : IA et vishing

1. Qu’est-ce que le vishing ?

Le vishing est une forme de fraude téléphonique où des cybercriminels se font passer pour des interlocuteurs de confiance. Leur but est de manipuler les victimes afin d’obtenir des informations sensibles ou des accès à des systèmes. Contrairement au phishing classique (par email), il repose sur des appels vocaux.

2. Qu’est-ce que le deepvoice ?

Le deepvoice utilise l’IA pour cloner des voix humaines de manière réaliste. En analysant quelques secondes d’un échantillon vocal, le logiciel peut créer des voix synthétiques proches de l’original. Les cybercriminels peuvent alors imiter des proches, des collègues ou des dirigeants d’entreprise pour renforcer la crédibilité de leurs attaques.

3. Comment les cybercriminels collectent-ils des échantillons vocaux ?

Les échantillons vocaux sont souvent récupérés via :

- Les réseaux sociaux (vidéos ou audios publics).

- Les enregistrements professionnels (conférences, interviews).

- Les fuites de données issues de diverses plateformes.

- Des enregistrements captés ou volés suite à un accès initial dans le système.

4. Le vishing est-il une menace croissante ?

Oui. Avec les progrès de l’intelligence artificielle, les attaques par vishing deviennent de plus en plus sophistiquées et difficiles à détecter. La vigilance et la prévention sont essentielles pour contrer cette menace en pleine expansion.

5. Quels sont les risques pour les entreprises face au vishing ?

Les entreprises sont exposées à plusieurs risques, notamment :

- Divulgation de données sensibles, comme des informations transmises par des clients.

- Compromission du système informatique avec effacement ou cryptage des données.

- Pertes financières liées à des virements frauduleux.

- Atteintes à la réputation de l’organisation.

6. Quels sont les bons réflexes pour éviter de subir une attaque par vishing ?

- Vérifiez toujours l’identité de votre interlocuteur avant de fournir des informations sensibles.

- Ne répondez pas aux demandes urgentes sans double vérification.

- Méfiez-vous des incohérences dans le discours ou le comportement de votre interlocuteur.

- Signalez tout appel suspect à votre service de sécurité ou à des autorités compétentes.

7. Comment se protéger contre les attaques combinant IA et vishing ?

Voici quelques mesures pour réduire les risques :

- Mettre en place l’authentification multi-facteurs (MFA).

- Utiliser des procédures de vérification d’identité strictes.

- Limiter la publication d’échantillons vocaux sur des plateformes publiques.

- Recourir à des outils de blocage et de détection des appels suspects.

- Sensibiliser les collaborateurs aux risques de vishing.

- Tester les défenses avec une simulation de vishing.

8. Qu’est-ce qu’une simulation de vishing ?

Une simulation de vishing est une mise en situation contrôlée visant à tester la capacité d’une organisation à reconnaître et contrer des attaques de vishing. Elle permet d’identifier les vulnérabilités, de sensibiliser les collaborateurs et d’améliorer les procédures de sécurité.

9. Est-ce qu’AvantdeCliquer propose des simulations de vishing ?

Oui, l’équipe d’AvantdeCliquer est experte dans la sensibilisation à toutes les formes d’attaques par ingénierie sociale depuis 2017. Nous pouvons vous accompagner pour tester la résistance de votre organisation et de vos collaborateurs à une attaque par vishing. Contactez-nous pour en savoir plus.